Einführung in die Rolle des SAP Solution Architekten

Die Rolle des SAP Solution Architekten ist entscheidend im Rahmen der Implementierung und Integration von SAP-Lösungen innerhalb eines Unternehmens. Diese Fachleute sind dafür verantwortlich, die technischen und funktionalen Anforderungen zu verstehen und eine Architektur zu entwerfen, die den geschäftlichen Bedürfnissen gerecht wird. Der SAP Solution Architekt agiert als Schnittstelle zwischen den verschiedenen Stakeholdern, darunter IT-Teams, Geschäftsanwender und das Management, um sicherzustellen, dass die entwickelten Lösungen sowohl effizient als auch anpassungsfähig sind.

Zu den wesentlichen Aufgaben eines SAP Solution Architekten gehört die Analyse bestehender Geschäftsprozesse und die Identifikation von Optimierungspotenzialen. Hierbei spielen Kenntnisse in den neuesten SAP-Technologien und -Produkten eine zentrale Rolle. Darüber hinaus sorgt der Architekt dafür, dass alle Lösungen den Unternehmensstandards für Sicherheit und Compliance entsprechen, was besonders in regulierten Branchen von Bedeutung ist.

Ein weiterer zentraler Aspekt der Arbeit eines SAP Solution Architekten ist das Stakeholder-Management. Der Architekt arbeitet eng mit verschiedenen Teams zusammen, um sicherzustellen, dass das gesamte Projektteam die Vision und Strategie der zielgerichteten SAP-Lösungen versteht. Dies umfasst auch die Schulung und Unterstützung von Anwendern, um die Akzeptanz und den erfolgreichen Einsatz der Lösungen sicherzustellen.

Die Bedeutung der Position des SAP Solution Architekten kann nicht unterschätzt werden, da sie die Brücke zwischen Technologie und Geschäftswelt darstellen. Durch ihre Expertise sind sie in der Lage, Lösungen zu entwickeln, die nicht nur die aktuellen Bedürfnisse erfüllen, sondern auch zukünftige Anforderungen antizipieren, um die Wettbewerbsfähigkeit des Unternehmens zu gewährleisten.

Wichtige Aufgaben eines SAP Solution Architekten

Die Rolle des SAP Solution Architekten ist entscheidend für den Erfolg der Implementierung von SAP-Systemen in Unternehmen. Eine der wichtigsten Aufgaben besteht in der Analyse von Geschäftsanforderungen. Hierbei arbeitet der Architekt eng mit den verschiedenen Stakeholdern zusammen, um die spezifischen Bedürfnisse der Organisation zu verstehen. Diese Anforderungen bilden die Basis für die darauf folgende Lösungsgebung und sollten detailliert dokumentiert werden, um sicherzustellen, dass alle relevanten Aspekte berücksichtigt sind.

Ein weiterer zentraler Aspekt der Tätigkeit eines SAP Solution Architekten ist das Design von Lösungskonzepten. Nach der Analyse folgt die Entwicklung eines detaillierten technischen und funktionalen Designs, das sowohl den Anforderungen des Unternehmens als auch den technischen Möglichkeiten der SAP-Plattform Rechnung trägt. Der Architekt muss dabei verschiedene Ansätze abwägen und innovative Technologien integrieren, um optimale Lösungen anzubieten. Die Erstellung von Prototypen und die Durchführung von Machbarkeitsstudien sind dabei gängige Praktiken, um die vorgeschlagenen Ideen zu validieren.

Zusätzlich zur Analyse und zum Design ist die Sicherstellung einer optimalen technischen Umsetzung von großer Bedeutung. Dies umfasst die enge Zusammenarbeit mit Entwicklungsteams sowie die Überwachung des Implementierungsprozesses. Der SAP Solution Architekt muss sicherstellen, dass die Lösung den Qualitätssicherungsstandards entspricht und effizient sowie fehlerfrei implementiert wird. Ein Beispiel aus der Praxis könnte ein Projekt sein, bei dem eine integrierte Supply-Chain-Lösung gebaut wurde, wobei der Architekt die gesamte Architektur plante, prüfte und die Umsetzung koordinierte. Durch solche umfassenden Aufgaben stellt der Architekt sicher, dass die Lösung sowohl funktional als auch technisch leistungsfähig ist.

Erforderliches Know-how im Bereich SAP

Ein SAP Solution Architekt ist gefordert, ein tiefgreifendes Verständnis verschiedener SAP-Module und -Technologien zu besitzen. Diese Expertise erstreckt sich über die zentralen Bereiche wie SAP ERP, SAP S/4HANA, SAP Fiori, sowie SAP Business Technology Platform. Jedes dieser Module bietet individuelle Funktionen und Möglichkeiten, die für unterschiedliche Unternehmensbedürfnisse konzipiert sind. Aus diesem Grund sollte der Architekt in der Lage sein, diese Technologien so zu kombinieren, dass sie optimale Lösungen bieten.

Die Kenntnis spezifischer SAP-Produkte ist unabdingbar, besonders in Bezug auf SAP Cloud Platform und SAP Integrated Business Planning. Diese Lösungen ermöglichen es Organisationen, agiler zu werden und sich an dynamische Marktbedingungen anzupassen. Ein SAP Solution Architekt muss nicht nur die technische Funktionsweise dieser Produkte verstehen, sondern auch wissen, wie sie nahtlos in bestehende Systeme integriert werden können.

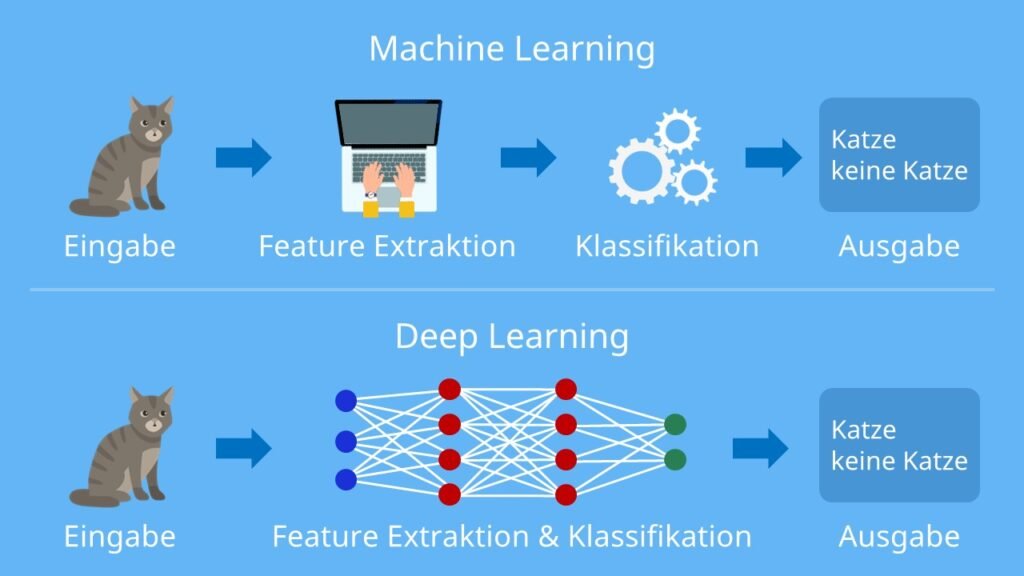

Darüber hinaus ist es entscheidend, dass der Architekt mit den aktuellen Trends in der SAP-Welt vertraut ist, wie etwa den fortschrittlichen Einsatz von Künstlicher Intelligenz, Machine Learning und das IoT (Internet der Dinge). Diese Technologien haben das Potenzial, SAP-Anwendungen erheblich zu erweitern und deren Funktionalität zu verbessern. Daher ist es für einen SAP Solution Architekten wichtig, ständig die Entwicklung in der SAP-Landschaft zu verfolgen und sich weiterzubilden.

Zusammengefasst sollte das erforderliche Know-how eines SAP Solution Architekten nicht nur technisches Wissen über die verschiedenen SAP-Module und -Technologien umfassen, sondern auch die Fähigkeit, die breite Palette von SAP-Produkten und deren Anwendungen in der Praxis zu kombinieren. Dies befähigt ihn, maßgeschneiderte Lösungen zu entwickeln, die den spezifischen Anforderungen eines Unternehmens gerecht werden.

Technische Fähigkeiten und Fähigkeiten zur Problemlösung

Ein SAP Solution Architekt spielt eine zentrale Rolle in der Implementierung und Optimierung von SAP-Lösungen innerhalb eines Unternehmens. Um in dieser Position erfolgreich zu sein, sind bestimmte technische Fähigkeiten unerlässlich. Zu den grundlegenden Kenntnissen gehören fortgeschrittene Programmierkenntnisse, insbesondere in Programmiersprachen wie ABAP, Java und SQL. Diese Fähigkeiten erleichtern es dem Architekten, maßgeschneiderte Lösungen zu entwickeln und individuelle Anpassungen zu implementieren, die den spezifischen Anforderungen eines Unternehmens gerecht werden.

Darüber hinaus ist ein tiefes Verständnis von Datenbanken und deren Verwaltung von großer Bedeutung. Kenntnisse über relationale Datenbanken, wie SAP HANA und Oracle, sowie über NoSQL-Datenbanken sind entscheidend. Diese Kenntnisse helfen, die Datenintegrität zu gewährleisten und optimale Datenabrufstrategien zu entwickeln. Ein erfolgreicher SAP Solution Architekt muss nicht nur wissen, wie man Daten speichert, sondern auch, wie man sie effizient abruft und analysiert, um fundierte Entscheidungen zu treffen.

Ein weiterer Aspekt der technischen Fähigkeiten sind die Fähigkeiten zur Integrationstechnologie. Dies umfasst das Verständnis von Middleware und Integrationsplattformen, die für den Datenaustausch zwischen verschiedenen Systemen unerlässlich sind. Die Verwendung von SAP PI (Process Integration) oder SAP PO (Process Orchestration) ermöglicht eine nahtlose Integration von Anwendungen, die von unterschiedlichen Anbietern stammen. Hierbei ist es wichtig, dass der Architekt die Prinzipien der API-Entwicklung und des Service-Oriented Architecture (SOA) beherzigt, um sicherzustellen, dass Systeme effizient und flexibel kommunizieren können.

Zusätzlich zu diesen technischen Fähigkeiten sind exzellente Problemlösungsfähigkeiten eine Voraussetzung für den Erfolg eines SAP Solution Architekten. Probleme erfordern oft kreative Lösungen und die Fähigkeit, unter Druck zu denken. Ein guter Architekt muss in der Lage sein, komplexe Herausforderungen zu analysieren, strategische Optionen zu evaluieren und implementierbare Lösungen zu entwerfen. Diese Kombination aus technischen Kenntnissen und Problemlösungsfähigkeiten ist entscheidend für die erfolgreiche Umsetzung von SAP-Projekten.

Beruflicher Hintergrund und Erfahrung

Ein SAP Solution Architekt benötigt einen soliden beruflichen Hintergrund und vielfältige Erfahrungen, um in der dynamischen IT-Landschaft erfolgreich zu sein. Häufig haben Fachleute in dieser Rolle einen Studienabschluss in Informatik, Wirtschaftsinformatik oder einem verwandten Bereich, der ihnen ein tiefes Verständnis für Geschäftsprozesse und technische Prinzipien verleiht.

Darüber hinaus sind praktische Erfahrungen in der Implementierung und dem Management von SAP-Systemen von entscheidender Bedeutung. Viele SAP Solution Architekten haben zuvor in Positionen als SAP-Consultants oder Projektmanager gearbeitet, wodurch sie wertvolle Einsichten aus erster Hand in die Herausforderungen und Chancen der Systemimplementierung gewinnen können. Diese praktischen Kenntnisse sind essenziell, um effektive Lösungen zu entwerfen, die den spezifischen Anforderungen von Unternehmen entsprechen.

Bildungswege, die für angehende SAP Solution Architekten von Vorteil sein können, umfassen zertifizierte SAP-Schulungen und -Programme, die den Teilnehmern spezifische Kenntnisse zu SAP-Lösungen und -Technologien vermitteln. Die Erlangung von Zertifizierungen, wie beispielsweise dem SAP Certified Technology Associate oder dem SAP Certified Application Associate, signalisiert nicht nur eine fundierte Ausbildung, sondern auch eine Verpflichtung zur kontinuierlichen Weiterbildung in diesem sich ständig weiterentwickelnden Bereich. Solche Zertifikate erhöhen auch die Wettbewerbsfähigkeit auf dem Arbeitsmarkt und eröffnen neue berufliche Perspektiven.

Zusammenfassend lässt sich sagen, dass ein umfassender beruflicher Hintergrund, gepaart mit relevanten Erfahrungen und gezielten Weiterbildungsmaßnahmen, entscheidend für einen erfolgreichen Karriereweg als SAP Solution Architekt ist. Die Kombination aus theoretischem Wissen und praktischen Fähigkeiten ermöglicht es Fachleuten, auf die zunehmend komplexen Anforderungen in der Unternehmenswelt zu reagieren und innovative Lösungen zu entwickeln.

Soft Skills für den Erfolg als SAP Solution Architekt

Die Rolle eines SAP Solution Architekten erfordert nicht nur technische Kenntnisse, sondern auch eine Vielzahl von Soft Skills, die entscheidend für den Erfolg in dieser Position sind. Zu den grundlegenden Fähigkeiten, die ein SAP Solution Architekt besitzen sollte, zählen hervorragende Kommunikationsfähigkeiten. Diese sind erforderlich, um komplexe technische Konzepte verständlich zu vermitteln, sowohl an technische als auch an nicht-technische Stakeholder. Klare Kommunikation fördert den Austausch von Ideen und sorgt dafür, dass alle Projektbeteiligten auf derselben Seite sind.

Teamarbeit ist ein weiterer wesentlicher Soft Skill, der den Workflow eines Unternehmens erheblich beeinflussen kann. Ein SAP Solution Architekt arbeitet häufig eng mit verschiedenen Abteilungen, Teammitgliedern und externen Partnern zusammen. Fähigkeit zur Zusammenarbeit ermöglicht es, verschiedene Perspektiven und Fachkenntnisse zu integrieren, was zu innovativen Lösungen führt. Ein Architekt, der gut im Team agieren kann, fördert nicht nur die Effizienz, sondern auch das positive Arbeitsklima.

Darüber hinaus ist Projektmanagement eine Schlüsselkompetenz, die für SAP Solution Architekten von großer Bedeutung ist. Ein effektives Management von Projekten gewährleistet, dass Ressourcen optimal genutzt und Fristen eingehalten werden. Der Architekt muss in der Lage sein, Prioritäten zu setzen, den Fortschritt zu überwachen und auftretende Probleme schnell zu lösen. Projektmanagementfähigkeiten sind entscheidend, um den gesamten Lebenszyklus eines Projektes zu steuern und sicherzustellen, dass die Lösung den Anforderungen des Unternehmens gerecht wird.

Insgesamt tragen diese Soft Skills dazu bei, die Zusammenarbeit und den Workflow innerhalb des Unternehmens zu verbessern und zum Erfolg von Projekten beizutragen. Ein SAP Solution Architekt, der sowohl technische als auch zwischenmenschliche Kompetenzen ausbalanciert, ist in der Lage, die Herausforderungen einer sich ständig verändernden Geschäftswelt effektiv zu bewältigen.

Beispiele für typische Projekte

Die Rolle eines SAP Solution Architekten umfasst die Planung, Gestaltung und Implementierung komplexer SAP-Lösungen in Unternehmen. Typische Projekte, an denen ein SAP Solution Architekt beteiligt ist, variieren je nach Branche und spezifischen Unternehmensanforderungen. Ein häufiges Projekt ist die Einführung von SAP S/4HANA, bei der der Architekt eine zentrale Rolle spielt. Hierbei ist es entscheidend, die bestehenden Geschäftsprozesse zu analysieren und diese effizient in die neue Systemlandschaft zu überführen.

Ein weiteres Beispiel sind Integrationsprojekte, die oft erforderlich sind, um SAP-Systeme mit bestehenden Anwendungen im Unternehmen zu verbinden. In solchen Projekten muss der Architekt sicherstellen, dass der Datenaustausch reibungslos verläuft und die Integrität der Daten gewahrt bleibt. Dies kann die Verwendung von Schnittstellen wie SAP PI oder SAP PO erfordern, die der Architekt entwerfen und konfigurieren muss.

Zusätzlich erleben viele Unternehmen die Herausforderung der Migration von Altsystemen auf moderne SAP-Lösungen. Hierbei kann der SAP Solution Architekt die Verantwortung für die Entwicklung einer umfänglichen Migrationsstrategie übernehmen. Diese umfasst die Planung der Datenmigration, das Testmanagement sowie die Schulung der Benutzer, um sicherzustellen, dass der Übergang so reibungslos wie möglich erfolgt.

Schließlich können auch Optimierungsprojekte, die darauf abzielen, bestehende SAP-Prozesse zu verbessern, in den Aufgabenbereich eines SAP Solution Architekten fallen. In solchen Projekten ist es wichtig, die aktuelle Systemarchitektur zu bewerten und Verbesserungsvorschläge zu entwickeln, um Effizienzgewinne zu realisieren und die Betriebskosten zu senken.

Herausforderungen im Arbeitsalltag eines SAP Solution Architekten

Die Rolle eines SAP Solution Architekten ist von zentraler Bedeutung für die erfolgreiche Implementierung und Nutzung von SAP-Lösungen in einem Unternehmen. Diese Fachleute stehen jedoch häufig vor einer Vielzahl von Herausforderungen, die die Komplexität ihrer Arbeit erhöhen. Eine dieser Herausforderungen ist die rasante Entwicklung von Technologien. SAP-Lösungen müssen kontinuierlich angepasst und aktualisiert werden, um den neuesten technologischen Standards und Anforderungen gerecht zu werden. Dies erfordert ein tiefes Verständnis der aktuellen Trends und Innovationen im IT-Sektor, einschließlich Cloud Computing, Künstliche Intelligenz und Big Data.

Ein weiterer wesentlicher Aspekt sind die hohen Erwartungen der Stakeholder. SAP Solution Architekten müssen in der Lage sein, die Bedürfnisse und Anforderungen der verschiedenen Interessengruppen zu identifizieren und in konkrete technische Lösungen umzuwandeln. Oftmals stehen diese Erwartungen in einem Spannungsfeld, das es zu navigieren gilt, da verschiedene Abteilungen unterschiedliche Prioritäten setzen. Ein erfolgreicher Architekt muss sowohl kommunikationsstark als auch verhandlungssicher sein, um alle Beteiligten in den Entscheidungsprozess einzubeziehen.

Darüber hinaus sind Integrationsprojekte eine weitere komplexe Herausforderung. Die Integration verschiedener Systeme und Datenquellen innerhalb eines Unternehmens kann zu Problemen führen, die sowohl technischer als auch infrastruktureller Natur sind. Diese Komplexität erfordert ein tiefgehendes Verständnis der bestehenden IT-Landschaft, sowie der Schnittstellen und Protokolle, die genutzt werden. Dies betrifft nicht nur die Implementierungsphase, sondern auch die kontinuierliche Wartung und Optimierung der Systeme.

Zusammenfassend lässt sich sagen, dass SAP Solution Architekten in ihrem Arbeitsalltag einer Vielzahl von Herausforderungen gegenüberstehen, die sowohl technologische als auch zwischenmenschliche Fähigkeiten erfordern. Die Fähigkeit, sich erfolgreich diesen Anforderungen zu stellen, ist entscheidend für den Erfolg der SAP-Implementierungen und das Erreichen der Unternehmensziele.

Fazit und Ausblick auf die zukünftige Entwicklung der Rolle

Die Rolle des SAP Solution Architekten hat sich in den letzten Jahren erheblich gewandelt. Die Anforderungen an diese Fachkräfte gehen über technisches Know-how hinaus. Ein SAP Solution Architekt benötigt umfangreiche Kenntnisse in den Bereichen Betriebswirtschaft, Projektmanagement sowie Entwicklung und Integration von SAP-Lösungen. Die Fähigkeit, zwischen verschiedenen Stakeholdern zu kommunizieren und deren Anforderungen zu verstehen, ist ebenso entscheidend. Um den Anforderungen dieser Rolle gerecht zu werden, sind insbesondere folgende Qualifikationen von Bedeutung:

- Umfassende Erfahrung mit SAP-Technologien und -Lösungen, einschließlich SAP S/4HANA, SAP Fiori und SAP Cloud Platform.

- Kenntnisse in den neuesten Trends, wie beispielsweise Künstliche Intelligenz und maschinelles Lernen, die zunehmend in SAP-Systeme integriert werden.

- Fundierte Projektmanagement-Kompetenzen, um Projekte effizient zu planen, durchzuführen und abzuschließen.

In der Zukunft wird von SAP Solution Architekten erwartet, dass sie nicht nur technologische Expertise mitbringen, sondern auch ein tiefes Verständnis für agile Methoden. Die Digitalisierung und die Cloud-Technologie verändern die Art, wie Unternehmen Operieren und sich weiterentwickeln. Dies führt zu einem steigenden Bedarf an Architekten, die in der Lage sind, innovative Lösungen zu entwickeln, die den spezifischen Bedürfnissen von Unternehmen gerecht werden.

Darüber hinaus wird die Zusammenarbeit mit interdisziplinären Teams von entscheidender Bedeutung sein. Das Verständnis für Branchenstandards und -trends wird die Arbeit des SAP Solution Architekten weiter beeinflussen, während sie sich anpassen müssen, um effizient in einem sich schnell verändernden Technologiekontext zu agieren.

Zusammenfassend lässt sich sagen, dass die Rolle des SAP Solution Architekten sowohl technische als auch strategische Aspekte umfasst, mit einem klaren Fokus auf kontinuierliche Weiterbildung und Anpassungsfähigkeit an neue Herausforderungen in der digitalen Landschaft.