Einführung in Code Reviews

Code Reviews sind ein entscheidender Bestandteil des Software-Entwicklungsprozesses und spielen eine zentrale Rolle bei der Qualitätssicherung in der Programmierung. Bei einem Code Review wird der Quellcode, der von einem Entwickler verfasst wurde, von einem oder mehreren anderen Entwicklern geprüft. Ziel dieser Überprüfung ist es, potenzielle Fehler oder Schwächen im Code zu identifizieren, die Lesbarkeit zu verbessern und die Einhaltung von Coding-Richtlinien sicherzustellen.

Die Durchführung von Code Reviews hat mehrere Vorteile. Erstens fördern sie die Zusammenarbeit innerhalb von Entwicklungsteams, indem sie den Austausch von Wissen und Best Practices unterstützen. Der Review-Prozess ermöglicht es den Beteiligten, voneinander zu lernen und unterschiedliche Perspektiven auf technische Herausforderungen zu entwickeln. Zweitens helfen Code Reviews dabei, die Codequalität zu steigern. Durch das frühzeitige Erkennen von Bugs und Inkonsistenzen in der Codebasis können Entwickler das Risiko minimieren, dass schwerwiegendere Probleme in späteren Phasen des Entwicklungszyklus auftreten.

In der Regel erfolgt ein Code Review entweder durch persönliche Meetings oder durch den Einsatz von speziellen Toolsets, die speziell für diesen Zweck entwickelt wurden. Unabhängig von der Methode ist es wichtig, dass das Feedback spezifisch und konstruktiv ist, um den Entwicklern zu helfen, ihre Fähigkeiten zu verbessern und gleichzeitig die Team-Moral zu fördern. Derartige Reviews sind nicht nur eine Maßnahme zur Fehlervermeidung, sondern auch ein integraler Bestandteil, um sicherzustellen, dass der Code den geplanten Anforderungen und Standards (Entwickler-Richtlinien) gerecht wird.

Die Herausforderungen bei Code Reviews

Obwohl Code Reviews ein wichtiger Bestandteil des Software-Entwicklungsprozesses sind, trotzdem bringen sie zahlreiche Herausforderungen. Eine der zentralen Schwierigkeiten ist der Zeitdruck, unter dem viele Entwickler stehen. Oftmals müssen Projekte Fristen einhalten, was dazu führt, dass Entwickler versuchen, den Review-Prozess zu beschleunigen oder sogar zu überspringen. Dieses Vorgehen kann dazu führen, dass potenzielle Fehler unentdeckt bleiben und am Ende die Softwarequalität darunter leidet.

Ein weiterer Aspekt, der die Durchführung effektiver Code Reviews herausfordernd macht, ist die zwischenmenschliche Kommunikation. Entwickler sind oft sehr in ihre eigene Denkweise und Arbeitsweise vertieft; dies kann dazu führen, dass Feedback, das in einem Code Review gegeben wird, nicht angemessen angenommen wird. Oftmals fühlen sich Entwickler angegriffen oder feindlich gegenüber dem Feedback, was die Zusammenarbeit im Team beeinträchtigen kann. Solche emotionalen Reaktionen können den gesamten Zweck des Reviews untergraben, nämlich die Verbesserung des Codes und des Wissensaustausches.

Darüber hinaus kann die Komplexität des Codes selbst eine Herausforderung darstellen. Wenn der Code umfangreich oder für die Prüfer schwer nachvollziehbar ist, besteht die Gefahr, dass wichtige Details übersehen werden. Um diese Herausforderungen zu meistern, ist es wichtig, klare Richtlinien und Tools zu etablieren, die den Review-Prozess unterstützen. Ein systematischer Ansatz kann dabei helfen, die Qualität der Reviews zu sichern, auch wenn der Zeitdruck hoch ist.

Zusammengefasst können Code Reviews unter Zeitdruck und durch zwischenmenschliche Aspekte erschwert werden, was die Softwareentwicklung negativ beeinflussen kann. Die Etablierung effektiver Strategien zur Durchführung von Code Reviews ist daher entscheidend, um diese Herausforderungen zu bewältigen.

Die Vielfalt der Programmierstile

In der Softwareentwicklung sind Programmierstile und -techniken von zentraler Bedeutung. Jedes Entwicklerteam bringt eine Vielzahl von Ansätzen mit, die sowohl von persönlichen Vorlieben als auch von den spezifischen Anforderungen eines Projekts beeinflusst werden. In einem Team können sich diese Stile stark unterscheiden, was zu einer reichen, aber auch komplexen Codebasis führen kann. Programmierer, die aus unterschiedlichen Hintergründen stammen und unterschiedliche Erfahrungen in der Softwareentwicklung gesammelt haben, neigen dazu, eigene Präferenzen in ihren Code-Designs zu zeigen. Diese Diversität kann aus verschiedenen Faktoren resultieren, wie den verwendeten Programmiersprachen, dem jeweiligen Paradigma (objektorientiert, funktional, etc.) und den individuellen Erfahrungen mit bestimmten Tools oder Frameworks.

Ein Beispiel für solche Unterschiede ist die Art und Weise, wie Entwickler ihre Funktionen strukturieren oder auf bestimmte Code-Patterns zugreifen. Während einige Programmierer den Fokus auf Lesbarkeit und einfache Wartbarkeit legen, könnten andere einen prioritär performanten Ansatz wählen, der möglicherweise schwerer verständlich ist. Diese Eigenschaften sind jedoch nicht intrinsisch negativ, sondern reflektieren vielmehr die individuellen Erfahrungen und die Herangehensweise an Programmierprobleme. Hier kommen Code Reviews ins Spiel. Sie sind ein strategisches Mittel, um die Diversität in den Programmierstilen zu navigieren. Während des Review-Prozesses haben Entwickler die Möglichkeit, unterschiedliche Perspektiven zu einem bestimmten Code zu hören und ihre eigenen Ansichten zu hinterfragen.

In einem gut strukturierten Code Review können Teammitglieder lernen, sich gegenseitig zu unterstützen und vereinte Lösungen zu finden. Indem die Beiträge verschiedener Programmierstile zusammengebracht werden, entsteht ein Gesamtergebnis, das sowohl von Vielfalt als auch von gemeinschaftlicher Verantwortung geprägt ist. Diese kollektive Wissensbasis fördert nicht nur die Qualität des Codes, sondern auch die Teamdynamik, da jeder Entwickler die Gelegenheit erhält, von anderen zu lernen und sein eigenes Repertoire an Techniken zu erweitern.

Vereinheitlichung des Code-Stils

Die Vereinheitlichung des Code-Stils spielt eine entscheidende Rolle im Software-Entwicklungsprozess, insbesondere in Teams, die an komplexen Projekten arbeiten. Ein einheitlicher Code-Stil fördert nicht nur die Lesbarkeit und Verständlichkeit des Codes, sondern vereinfacht auch die Wartung und Weiterentwicklung der Software. In diesem Zusammenhang kommen Code Reviews als essentielles Instrument ins Spiel, um sicherzustellen, dass alle Teammitglieder die festgelegten Richtlinien befolgen.

Bei der Durchführung von Code Reviews überprüfen Entwicklungsmitarbeiter den geschriebenen Code ihrer Kollegen auf Übereinstimmung mit den definierten Standards. Dieser Prozess hilft, etwaige Abweichungen im Code-Stil frühzeitig zu identifizieren und zu korrigieren. Durch regelmäßige Reviews können Teams nicht nur den Stil des Codes vereinheitlichen, sondern auch bewährte Praktiken und landläufige Standards implementieren. Dies beinhaltet Aspekte wie die richtige Einrückung, Namenskonventionen für Variablen und Methoden, sowie die Struktur und Dokumentation des Codes.

Eine einheitliche Codebasis erleichtert nicht nur die Zusammenarbeit innerhalb des Teams, sondern sorgt auch dafür, dass neue Mitglieder schneller einsteigen können. Audit-orientierte Codes, die strengen Konventionen folgen, ermöglichen es Entwicklern, sich auf die Problemlösung zu konzentrieren, anstatt Zeit mit dem Rätseln über Unterschiede im Codestil zu verlieren. Darüber hinaus kann eine klare Dokumentation der Stilrichtlinien und die Schulung neuer Teammitglieder in deren Anwendung wesentliche Vorteile für das gesamte Entwicklungsteam bringen. Diese Maßnahmen tragen dazu bei, ein gemeinsames Verständnis für qualitativ hochwertige Codierung zu fördern.

Entwicklung von lesbarem und wartbarem Code

Die Entwicklung von lesbarem und wartbarem Code ist ein zentraler Aspekt in der Software-Entwicklung, der maßgeblich zur Effizienz und Zuverlässigkeit von Softwareprojekten beiträgt. Lesbarer Code ermöglicht es Entwicklern, die Logik und den Zweck der Implementierung schnell zu erfassen, was besonders wichtig ist, wenn mehrere Teammitglieder an einem Projekt arbeiten oder wenn nach längeren Zeiträumen an den Code zurückgekehrt wird. In diesem Zusammenhang spielen Code Reviews eine fundamentale Rolle.

Durch regelmäßige Code Reviews können Teams sicherstellen, dass der Code nicht nur funktional, sondern auch verständlich ist. Während des Review-Prozesses erhalten andere Entwickler die Gelegenheit, den Code zu überprüfen und Vorschläge zur Verbesserung der Lesbarkeit zu unterbreiten. Dies kann die Verwendung klarer Bezeichner, gut kommentierter Abschnitte und eine konsistente Formatierung umfassen. Der Austausch von Best Practices während dieser Überprüfungen führt nicht nur zu umsetzbarem Feedback, sondern fördert auch den gemeinsamen Wissensaustausch im Team.

Ein weiterer Vorteil von Code Reviews ist, dass sie sicherstellen, dass der Code zukunftssicher ist. Wenn der Code von mehreren Personen gelesen und kommentiert wird, ist die Wahrscheinlichkeit höher, dass zukünftige Änderungswünsche oder Bugfixes effizient umgesetzt werden können. Dies trägt zur Wartbarkeit des Codes bei, da klar dokumentierte und getestete Abschnitte weniger anfällig für Fehler sind. Letztlich führt dies zu einer stabileren Software, die in der Lage ist, sich den sich ändernden Anforderungen der Anwender anzupassen.

Daher ist es unerlässlich, Code Reviews als integralen Bestandteil des Entwicklungsprozesses zu betrachten, um die Lesbarkeit und damit die Wartbarkeit des Codes zu sichern und langfristig zu fördern.

Fehlervermeidung durch Code Reviews

Ein wichtiger Punkt beim Code-Review ist natürlich die Fehlerentdeckung. Durch die Prüfung des Quellcodes von Kollegen können Fehlerquellen frühzeitig identifiziert und behoben werden. Dies trägt nicht nur zur Verbesserung der Code-Qualität bei, sondern minimiert auch die Wahrscheinlichkeit von fehlerhaften Implementierungen, die zu längeren Entwicklungszeiten und höheren Kosten führen können.

Nicht weniger kommt es vor, wiederkehrende Fehler zu erkennen. Oftmals führen Entwickler unbewusst zu ähnlichen Problemen, die sich in unterschiedlichen Softwareprojekten wiederholen. Durch regelmäßige Überprüfungen kann das Team Muster und Trends in den Fehlern identifizieren, was zu gezielten Schulungen und einer verstärkten Sensibilisierung für diese Probleme führt. In diesem Kontext wird die gesamte Entwicklungspraktik gestärkt, da alle Beteiligten umfassendere Kenntnisse über bewährte Verfahren entwickeln.

Darüber hinaus bietet der Prozess des Code Reviews die Gelegenheit zur Wissensweitergabe innerhalb des Teams. Wenn etablierte Entwickler ihre Erfahrungen und Lösungsansätze anderen Teammitgliedern vermitteln, wird die gesamte Kompetenz des Teams erhöht. Dies führt zu einer besseren Fehlervermeidung, da weniger erfahrene Entwickler von den Kenntnissen der erfahreneren Kollegen profitieren.

Ein weiterer Vorteil von Code Reviews ist die bessere Dokumentation von Entscheidungen im Entwicklungsprozess. Durch die detaillierte Diskussion von Code-Änderungen und deren Begründungen im Rahmen eines Code Reviews wird eine Referenz geschaffen, auf die das Team in Zukunft zurückgreifen kann. Solche dokumentierten Entscheidungen helfen nicht nur bei der Fehlersuche, sondern auch dabei, die Wartbarkeit und Lesbarkeit des Codes zu erhöhen.

Automatisierung von Code Reviews

Die Automatisierung von Code Reviews ist ein dynamischer Bestandteil des Software-Entwicklungsprozesses, der sich kontinuierlich weiterentwickelt. Der Hauptzweck von Code Reviews besteht darin, die Code-Qualität zu sichern und sicherzustellen, dass der Code den festgelegten Standards entspricht. Mit der Einführung moderner Technologien und Werkzeuge lassen sich Code-Reviews teilweise automatisieren, was den Entwicklungsprozess beschleunigen und die Effizienz steigern kann.

Zu den führenden Tools, die die Automatisierung von Code Reviews unterstützen, gehören statische Code-Analysetools wie SonarQube und AbapLint. Diese Werkzeuge analysieren den Code automatisch und identifizieren Sicherheitsanfälligkeiten, Codefehler und Verstöße gegen die Coding-Standards. Durch die Integration solcher Tools in die kontinuierliche Integrationspipeline wird sichergestellt, dass der Code regelmäßig auf Probleme überprüft wird, ohne dass menschliche Überprüfung immer zwingend erforderlich ist. Jedoch können automatisierte Tools nicht alle Nuancen des Codes erfassen, die durch menschliches Urteilsvermögen besser begriffen werden.

Darüber hinaus gibt es automatische Code-Genugtuungstools, die Entwicklern helfen, die von ihnen geschriebenen Skripte zu verbessern und Optimierungsvorschläge anzubieten. Diese Systeme verwenden künstliche Intelligenz und maschinelles Lernen, um Feedback zu geben, das auf bestehenden Codebasen basiert. Dennoch bleibt das Risiko, dass diese Tools nicht sämtliche kontextuellen oder projektspezifischen Merkmale erkennen, die für eine umfassende Bewertung notwendig sind.

Insgesamt sind automatisierte Code Reviews wertvolle Hilfsmittel, die den Software-Entwicklungsprozess optimieren können. Sie sollten jedoch nicht als vollständiger Ersatz für menschliche Überprüfungen betrachtet werden. Die Kombination aus automatisierten Tools und menschlicher Expertise ist entscheidend, um qualitativ hochwertigen und fehlerfreien Code zu gewährleisten.

Häufige Fehler in ABAP-Programmen

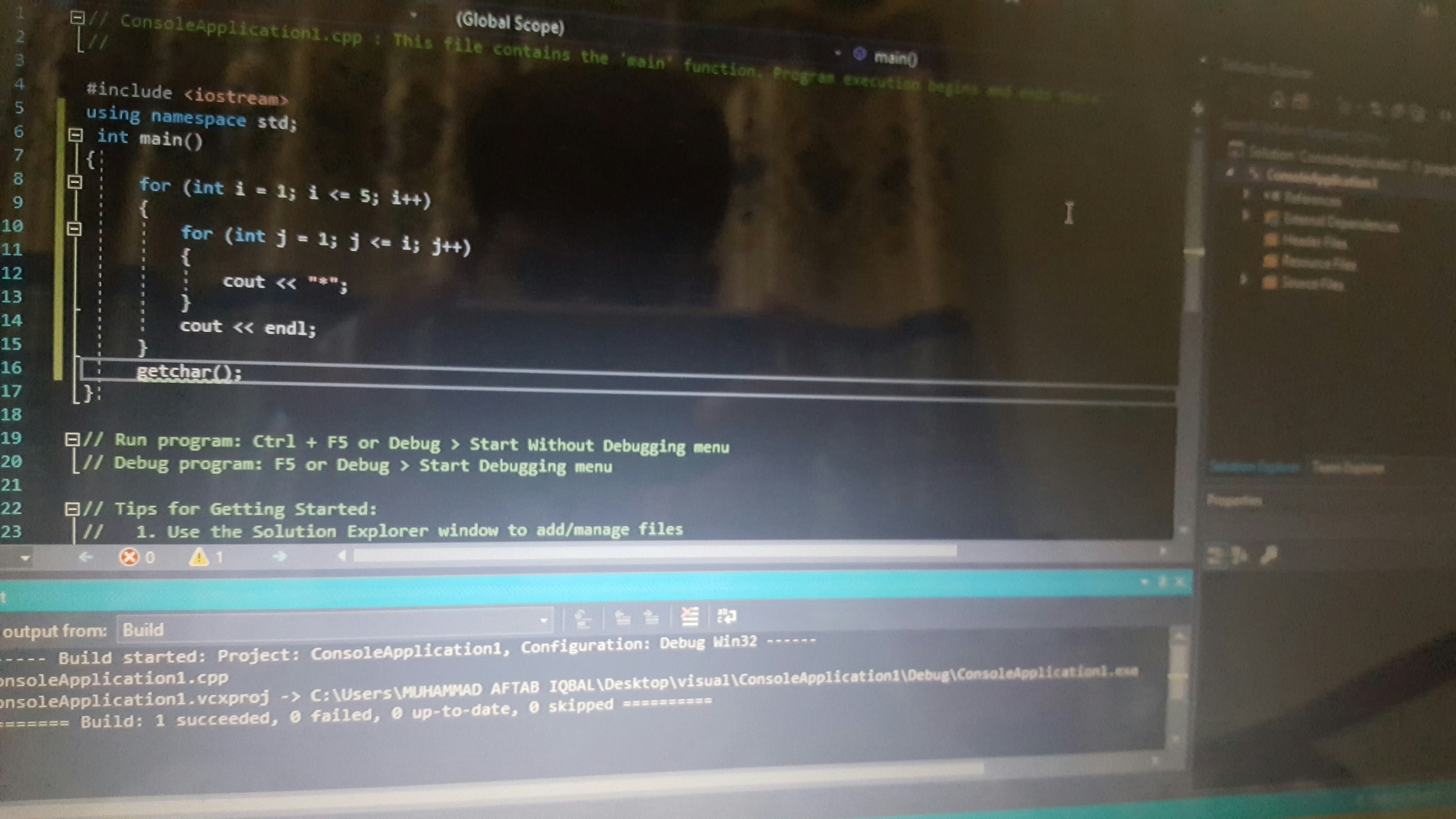

ABAP, die Programmiersprache für SAP-Anwendungen, wird häufig für die Entwicklung von Unternehmenssoftware verwendet. Trotz ihrer Popularität treten in der Praxis oft diverse Fehler auf, die die Qualität und Funktionalität der Software beeinträchtigen können. Zu den häufigsten Fehlern gehören Themen wie ineffiziente Datenbankabfragen, unzureichende Fehlerbehandlung und das Versäumnis, Standardkonventionen einzuhalten.

Einer der häufigsten Fehler ist die Verwendung von Nested Selects, die die Performance erheblich negativ beeinflussen können. In solchen Fällen kann eine fehlerhafte Implementierung zu langen Ladezeiten und ineffizienten Datenabrufen führen. Verwenden von Joins anstelle von mehreren separaten Abfragen hilft, solche Probleme zu vermeiden. Hier kommen Code Reviews ins Spiel, da sie dazu beitragen können, diese ineffizienten Abfragen frühzeitig zu identifizieren und geeignete Lösungen zu empfehlen.

Ein weiteres häufiges Problem ist die mangelhafte Handhabung von Ausnahmen. In ABAP kann eine unzureichende Fehlerbehandlung dazu führen, dass unerwartete Situationen nicht richtig verwaltet werden. Dies kann in Bereichen wie der Kommunikation mit Datenbanken oder beim Umgang mit Benutzereingaben fatale Folgen haben. Ein kollektiver Review-Prozess fördert das Bewusstsein für Best Practices und ermöglicht es den Entwicklern, aus den Fehlern ihrer Kollegen zu lernen.

Zusätzlich wird oft versäumt, Code-Dokumentationen zu aktualisieren. Mangelnde Dokumentation kann zu Verwirrung führen und macht es für andere Entwickler schwierig, die Absicht und Funktionalität des Codes nachzuvollziehen. Regelmäßige Code Reviews können sicherstellen, dass die Dokumentation der ABAP-Programme stets auf dem neuesten Stand ist, was die Wartbarkeit und Verständlichkeit des Codes verbessert.

Insgesamt ist die Identifizierung und Behebung dieser häufigen Fehler durch regelmäßige Code Reviews im ABAP-Entwicklungsprozess von großer Bedeutung, um die Qualität der Software zu gewährleisten und die Effizienz der Entwicklungsarbeit zu steigern.

Fazit und Best Practices für erfolgreiche Code Reviews

Code Reviews sind ein wesentlicher Bestandteil des Software-Entwicklungsprozesses und tragen zur Verbesserung der Codequalität, zur Wissensverbreitung innerhalb des Entwicklerteams und zur Identifizierung von Fehlern bei. Um den Prozess der Code Reviews zu optimieren, ist es wichtig, bestimmte Best Practices zu berücksichtigen, die dabei helfen, die Effektivität zu steigern und die Wahrscheinlichkeit von Fehlern zu minimieren.

Eine der grundlegenden Empfehlungen ist es, Code Reviews in den Arbeitsablauf zu integrieren, anstatt sie als bloße Formalität zu behandeln. Regelmäßige Überprüfungen fördern eine Kultur der Zusammenarbeit und ermutigen die Teammitglieder, aktiv am Entwicklungsprozess teilzuhaben. Die Einführung von festen Zeitpunkten für Code Reviews sowie klaren Kriterien für die Durchsicht kann den Ablauf strukturieren und beschleunigen.

Des Weiteren sollten Code Reviews zielgerichtet und überschaubar sein. Es ist ratsam, nicht zu viele Änderungen auf einmal zu überprüfen, da dies die Analyse und das Verständnis des Codes erschwert. Kleinere, fokussierte Pull-Requests fördern eine präzisere Rückmeldung und erhöhen die Wahrscheinlichkeit, dass wichtige Aspekte berücksichtigt werden. Feedback sollte konstruktiv und lösungsorientiert formuliert sein, um eine positive Atmosphäre zu schaffen.

Ein weiterer wichtiger Aspekt ist die Nutzung von Tools, die den Code-Review-Prozess unterstützen können. Plattformen wie GitHub oder GitLab bieten integrierte Funktionen für Code Reviews, die eine einfache Kommentierung und Diskussion ermöglichen. Zudem sollten Entwickler darauf achten, sich kontinuierlich weiterzubilden und aktuelle Best Practices zu verfolgen. Workshops oder Schulungen zu Code-Review-Techniken können die Kompetenz des gesamten Teams steigern.

Zusammenfassend lässt sich sagen, dass durch die Anwendung dieser Best Practices die Qualität der Software verbessert und die Effizienz des Entwicklungsprozesses erhöht werden können. Ein gut gestalteter Code-Review Prozess ist entscheidend für den langfristigen Erfolg von Softwareprojekten.